Het gebruik van kunstmatige intelligentie, zoals ChatGPT is voor veel mensen een behoorlijke uitdaging. Een feit is dat ChatGPT soms fouten maakt in de antwoorden die het geeft. Dit artikel richt zich op hoe we deze beperkingen kunnen begrijpen en wat we eraan kunnen doen.

Samenvatting

- ChatGPT maakt soms fouten, zoals grammaticale, mathematische en feitelijke fouten doordat het programma leert van grote hoeveelheden tekst.

- Het systeem kan bevooroordeelde antwoorden geven, omdat het leert van informatie die soms niet juist of eerlijk is.

- ChatGPT mist menselijk inzicht, waardoor het moeite heeft met het herkennen van gevoelens zoals sarcasme en humor.

- De technologie geeft soms lange en complexe antwoorden op simpele vragen, wat voor managers vervelend kan zijn als tijd beperkt is.

- Het is belangrijk om de regels van jouw organisatie te volgen bij het gebruik van ChatGPT, met aandacht voor veiligheid en privacy.

Beperkingen van ChatGPT

ChatGPT kan veel, maar niet alles. Het maakt soms fouten en mist het inzicht die mensen wel hebben.

Onjuiste antwoorden

ChatGPT kan soms fouten maken. Dit komt doordat het programma leert van grote hoeveelheden tekst. Maar niet alle informatie die het heeft geleerd, is juist. Denk aan grammaticale, mathematische en feitelijke fouten.

Soms geeft het antwoorden die klinken alsof ze kloppen, maar dat niet zijn. Dit kan lastig zijn als je vertrouwt op de gegeven informatie.

Een specifiek voorbeeld hiervan is wanneer je vraagt over recente gebeurtenissen. Omdat ChatGPT getraind is tot een bepaald punt in tijd, kan het geen informatie geven over dingen die daarna zijn gebeurd.

Als je vraagt naar iets heel actueels, zoals de laatste beslissingen in de politiek of laatste wetenschappelijke nieuws, kan ChatGPT het mis hebben of helemaal geen antwoord geven.

Dit is belangrijk om te onthouden bij het gebruiken van deze technologie voor snelle feiten of actuele informatie.

Vooroordelen in antwoorden

Vooroordelen in antwoorden zijn een groot probleem. Deze komen door de manier waarop het AI-systeem leert. Het systeem krijgt informatie uit veel bronnen, zoals Wikipedia en nieuwsartikelen vanuit allerlei websites.

Maar soms is deze info niet helemaal juist of eerlijk. Dat kan leiden tot bevooroordeelde antwoorden. Denk aan een vraag over historische gebeurtenissen.

Als de info die het systeem leerde, eenzijdig was, kan het een verkeerd beeld geven.

We moeten ook onthouden dat het systeem leert van de makers ervan. Mensen maken fouten of hebben soms zelf vooroordelen. Dit kan invloed hebben op wat het systeem leert. Het is net als bij mensen: wat je leert, bepaalt hoe je denkt.

Managers moeten dus kritisch kijken naar de antwoorden die ze krijgen wanneer ze ChatGPT voor hun bedrijf inzetten. Ze moeten zich afvragen: “Komt dit echt overeen met wat ik weet?” Zo blijven ze scherp en kunnen ze beter beslissen.

Gebrek aan menselijk inzicht

ChatGPT mist menselijk inzicht. Dit betekent dat de bot moeite heeft met het herkennen van gevoelens zoals sarcasme en humor. Ook begrijpt de chatbot geen subtekst, waardoor hij geen diepgaande inzichten kan bieden.

Praktische ervaring en gezond verstand ontbreken, wat het voor ChatGPT lastig maakt om situaties goed te begrijpen.

De chatbot kan ook regionale uitdrukkingen of specifiek jargon verkeerd opvatten. Dit komt doordat ChatGPT niet weet hoe mensen echt denken of voelen. Het systeem kan geen nieuwe perspectieven bieden, omdat het afhankelijk is van bestaande kennis en ervaringen die mensen hebben gedeeld.

Zo blijft de chatbot beperkt in zijn mogelijkheden om echt als een mens te denken of te reageren.

De kwaliteit van de output van ChatGPT is ook afhankelijk van je input. Kortom, probeer de chatbot ook meer achtergrondinformatie te geven en geef informatie over je doelgroep. Ook je schrijfstijl zou je menselijker kunnen maken door het gebruik van gepersonaliseerde prompts.

Lange of verwarrende antwoorden

Soms geeft chatGPT lange en complexe antwoorden op simpele vragen. Dit kan vervelend zijn, vooral als tijd beperkt is. Korte en duidelijke antwoorden zijn vaak meer betrouwbaar.

De uitdaging ligt in het filteren van nuttige informatie uit de overvloed aan details.

Het vermogen van de technologie om te begrijpen wat echt belangrijk is, is dus niet altijd perfect. Het mist soms de kern van wat er gevraagd wordt. Dit leidt tot antwoorden die eigenlijk meer verwarring zaaien dan dat het opheldering kan geven.

Gebruikers van ChatGPT moeten dan extra tijd besteden aan het ontcijferen van de informatie. Dit is niet altijd even ideaal in een snel bewegende werkomgeving.

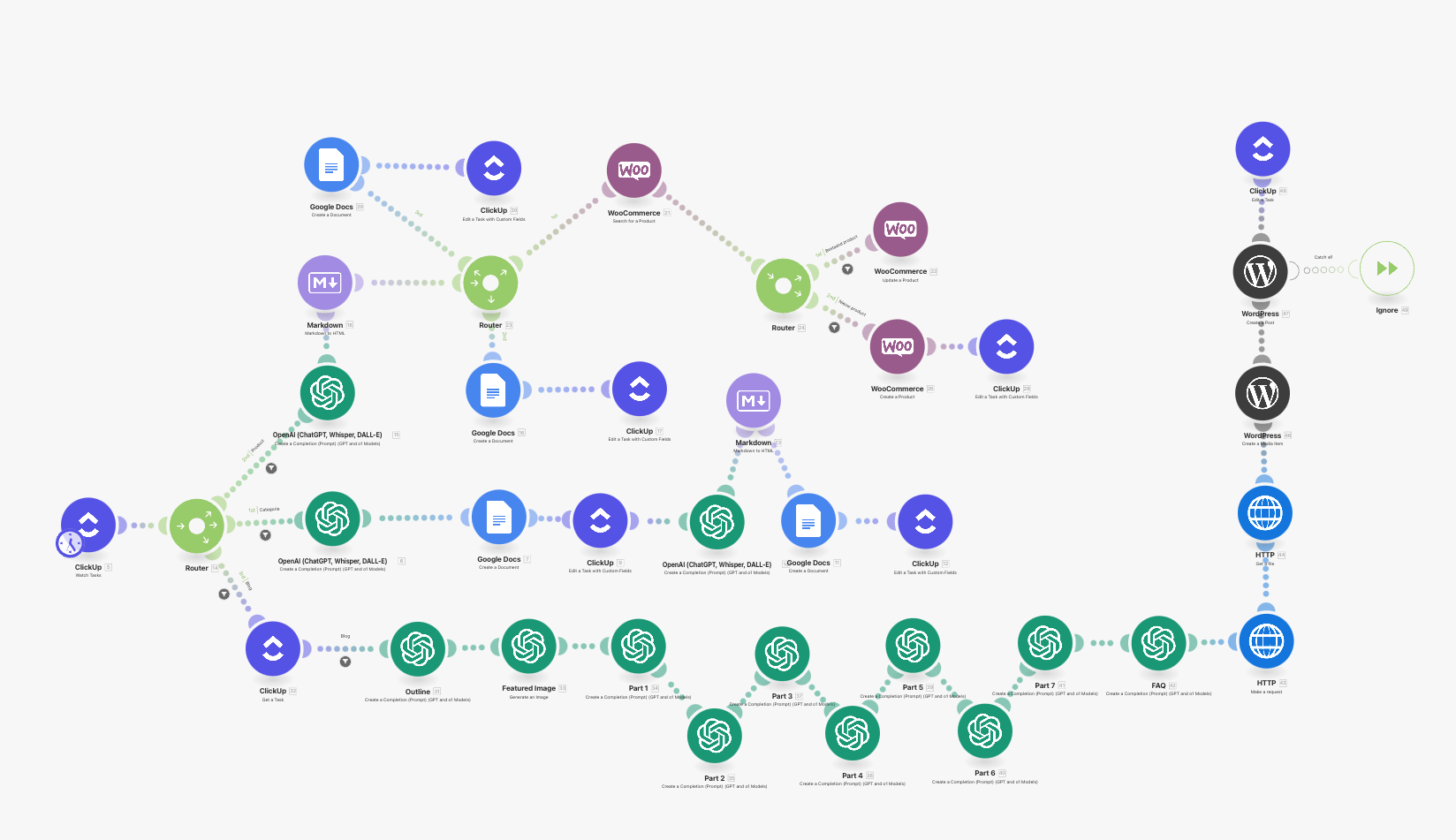

Richtlijnen voor gebruik van ChatGPT

Zorg altijd dat je de regels van jouw organisatie volgt bij het gebruik van ChatGPT. Dit houdt in dat je goed op moet letten welke informatie je deelt en hoe je die gebruikt. Denk eraan, veiligheid en privacy zijn erg belangrijk.

Ontdek meer over slim en veilig gebruik van deze technologie!

Volg de richtlijnen van je bedrijf

Of het nu gaat om een bedrijf of instelling ieder heeft zijn eigen regels voor het gebruik van technologie. Dit geldt ook voor tools als ChatGPT. Managers moeten deze regels goed kennen en volgen. Dit helpt problemen te voorkomen en zorgt ervoor dat iedereen de tool op de juiste manier gebruikt.

Belangrijk is te weten wat uw bedrijf zegt over natuurlijke taalverwerking (NLP) en kunstmatige intelligentie (AI). Sommige organisaties staan misschien open voor experimenten met nieuwe technologieën.

Andere kunnen strenger zijn. Respecteer deze grenzen altijd. Dit zorgt voor een veilige en verantwoorde omgang met AI binnen uw organisatie.

Conclusie

ChatGPT heeft zeker zijn grenzen. Het maakt fouten en soms komen die antwoorden niet eens in de buurt van wat we nodig hebben. Dat maakt het lastig, vooral als we op zoek zijn naar nauwkeurige info.

ChatGPT kan achterlopen. Maar onthoud dit: het is een hulpmiddel. Net als elke andere tool, hangt het succes ervan af hoe wij het gebruiken.

Stel de juiste vragen, wees kritisch over de antwoorden en gebruik het als een springplank. Zo haal je het beste uit ChatGPT, ondanks zijn beperkingen.

Veelgestelde vragen

ChatGPT, ontwikkeld met neurale netwerken, kan inderdaad interactieve gesprekken voeren over een breed scala aan onderwerpen. Echter, het mist het bewustzijn en diepgaande begrip van een expert. Dit betekent dat het soms de nuances van complexe historische gebeurtenissen kan missen.

ChatGPT kan feiten leveren over de Slag bij Waterloo, maar zijn vermogen om diepgaand en met volledige nauwkeurigheid te analyseren is beperkt. Het ontbreekt aan menselijke intuïtie en kan daarom soms details over het hoofd zien of vereenvoudigen.

ChatGPT kan assistentie bieden bij het schrijfproces door informatie te genereren en structuur te bieden. Echter, voor wetenschappelijke tijdschriften is vaak een niveau van detail en nauwkeurigheid vereist die ChatGPT mogelijk niet altijd kan waarborgen.

ChatGPT heeft toegang tot een enorme hoeveelheid informatie en kan gebruikt worden om diverse perspectieven te presenteren. Toch heeft het geen eigen mening of bewustzijn, wat betekent dat het herkennen van en adequaat reageren op polarisatie lastig is.

ChatGPT kan ondersteunen bij SEO door relevante trefwoorden te identificeren en te integreren in content. Maar, voor optimale SEO-prestaties is menselijk inzicht nodig om de content echt af te stemmen op specifieke zoekintenties en trends.